Nvidia continúa sus esfuerzos cuánticos y HPC con implementaciones adicionales de CUDA-Q y Grace Hopper Superchip

Los sitios que implementan la plataforma tienen su sede en Alemania, Polonia y Japón

Los sitios que implementan la plataforma tienen su sede en Alemania, Polonia y Japón

La actualización ha sido financiada por el programa Francia 2030

MLPerf Inference es una suite de evaluación comparativa que mide el rendimiento de la inferencia en casos de uso de aprendizaje profundo

Aveva, filial de Schneider, se integrará con Nvidia Omniverse para gemelos digitales

Compañía aportará su experiencia en soluciones de refrigeración y alimentación de alta densidad a la red de socios de NVIDIA

Compañía ofrecerá modelos y aplicaciones basados en microservicios NVIDIA para mejorar el rendimiento en todas las cargas de trabajo

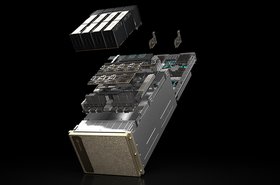

Permitiría a los clientes construir y ejecutar IA generativa en tiempo real con billones de parámetros con un consumo de energía 25 veces menor que la serie Hopper

Empresas colaboran para ofrecer servicios de computación acelerada e IA generativa que establezcan la soberanía digital y gestionen los datos nacionales y personales propietarios

Han sido construidos para apoyar la investigación y desarrollo de IA

Mientras el negocio de las GPU continúa su meteórico ascenso

También podría construir chips personalizados para telecomunicaciones, automóviles y videojuegos

Las empresas han colaborado anteriormente en áreas como el espacio informático para centros de datos y dispositivos de colaboración

La unidad de negocio registró ventas por valor de 2.280 millones de dólares en los últimos tres meses

Equinix ofrece a las empresas una nube privada lista para usar con NVIDIA DGX SuperPOD

La mayoría de los proveedores analizados por Gartner experimentaron una disminución interanual de sus ingresos en los últimos 12 meses

Después de aplazar la entrada a DGX Cloud

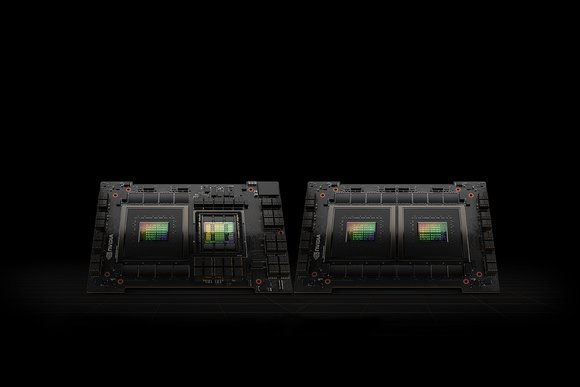

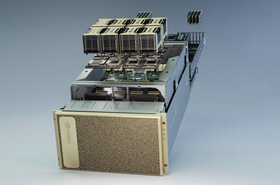

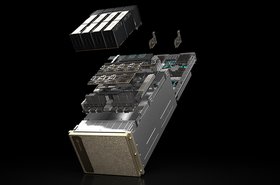

Con 16.000 superchips Grace Hopper

Ya se han publicado los resultados del tercer trimestre del año fiscal 2024 de la compañía

Jupiter también contará con la CPU de SiPearl

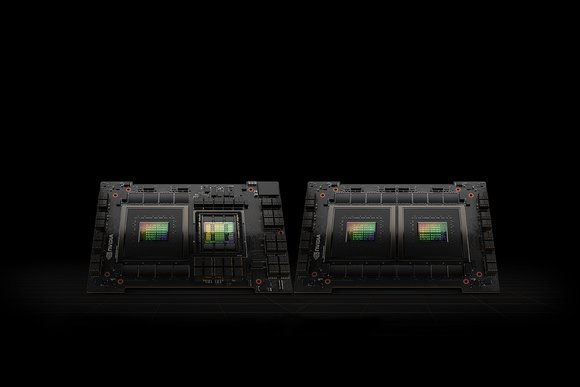

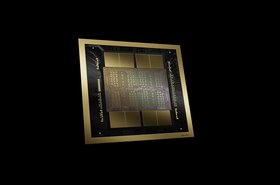

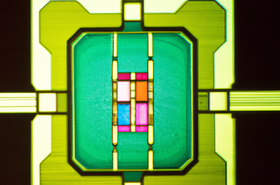

El H200 cuenta con 141 GB de HBM3e y un ancho de banda de memoria de 4,8 TBps

El nuevo clúster permitirá a los usuarios acelerar su formación en inteligencia artificial y aprendizaje automático (ML)

Las compañías prometen una “nueva clase de centros de datos” para implementaciones en fábricas

Valoraría el negocio de GPU en 1.500 millones de dólares

Su objetivo es reducir su dependencia de Nvidia

La compañía ya ha proporcionado acceso preferencial a su suministro limitado de H100 a proveedores de nube más pequeños y luego ha invertido en ellos